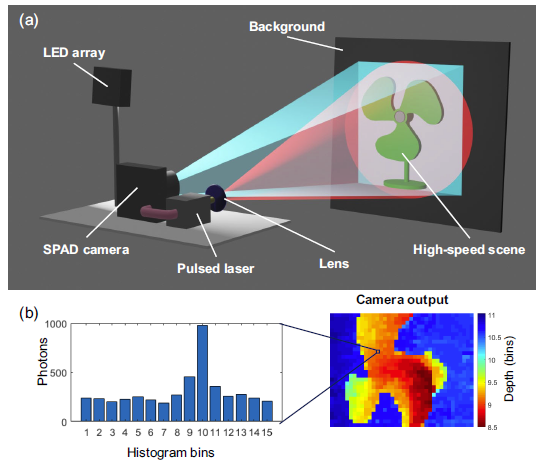

3D深度感知在越来越多的场景和中得到应用,包括自动驾驶车辆、工业机器视觉、人机界面手势识别,以及增强和虚拟现实。在许多捕捉深度的方法中,飞行时间(ToF),它用调制或脉冲光源照亮场景并测量背向散射光的返回时间,该方法越来越多的受到人们的关注。其优势包括在几米到几公里的距离上具有超过厘米级的深度分辨率。与其他技术相比,如立体镜,其计算成本很低,而且不依赖于场景的变化。此外,ToF使用简单的照明结构光,而不是经过复杂设计的光路结构。虽然通常ToF的帧速率为每秒10~60帧(FPS),但是如果捕获速率更快,延迟更小,这对于一些场景中的应用是非常有必要的,例如,在自动驾驶汽车中,快速的环境3D视图的捕捉将有助于确保及时检测到障碍。近年来,具有皮秒计时能力的单光子雪崩二极管(SPAD)阵列成为驱动这些系统向前发展的关键技术。

近日,英国爱丁堡大学集成微纳米系统研究所Istvan Gyongy等人报道了一个由最先进SPAD传感器架构的高速的三维成像系统,用于混合成像模式,可执行多事件记录。这种混合成像模式在光子计数和定时帧之间交替,速率超过每秒1000帧,能够引导深度数据从原生分辨率64×32提升到256×128。硬件和信号处理系统的相结合使得研究人员能够在室外条件和低延迟下进行高速ToF 3D成像。结果表明,在一系列的潜在应用中,其中实时,高吞吐量数据是必要的。其中一个例子就是在自主系统和机器人技术中提高态势感知的准确性和速度。相关研究工作发表在《Optica》上。(丁雷)

文章链接:Istvan Gyongy,et al, High-speed 3D sensing via hybrid-mode imaging and guided upsampling. Optica(2020).

https://doi.org/10.1364/OPTICA.390099.

客服热线:

客服热线: